近日,若想给房东写一封语气强硬的邮件,反映天花板漏水的问题,需要找人帮忙把关,ChatGPT或许是个合适的工具。不过和所有同类产品一样,ChatGPT也有不少有案可查的缺点:它不仅经常生成虚假信息,还带有一种讨好的语气,很容易让用户产生严重的认知错误。

换句话说,它绝非人们处理重要工作时可以依赖的工具,科隆大学植物科学教授马塞尔・布赫就吃了大亏,才明白了这个道理。

布赫在《自然》杂志的一篇专栏文章里直言,自从关闭了ChatGPT的“数据授权”功能,他过去两年里用心整理的学术成果,像科研经费申请材料、论文修订稿、课程讲义以及考试题目等,全都“消失不见了”。

他当初关闭这项功能,是想验证“即便不向OpenAI提供个人数据,自己是否仍能使用该模型的全部功能”。可让他崩溃的是,所有聊天记录一下子就消失得无影无踪了。

“没有任何预警提示,”布赫写道,“也没有撤销选项,只留下一片空白的页面。”

这篇专栏发布后,有网友提出疑问,布赫为何两年来都未进行本地备份?还有人十分愤怒,呼吁校方将他解雇,原因是他在学术工作里对人工智能过度依赖。

不过,也有部分人对他报以同情。海德堡大学的教学协调员罗兰・格罗姆斯在社交平台发布内容表示:“虽然马塞尔・布赫的工作流程存在不少漏洞,还犯下了一个愚蠢的错误,但他勇于公开这段经历的行为,是值得认可的。不少科研人员都自认为能够识破所有的陷阱,可实际情况是,每个人都有可能因为一时的疏忽,遇到这样的麻烦。”

布赫也率先承认,ChatGPT生成的内容“看似言之凿凿,实则有时漏洞百出”。他强调自己从未“将模型的可靠性等同于内容的真实性”,但他“信赖平台工作区的连续性和表面稳定性”,每天都把ChatGPTPlus当作贴身助手使用。

生成式人工智能在科学界的应用,始终伴随着持续的争议。据《大西洋月刊》消息,众多来源存疑、由AI拼凑而成的低质量稿件正不断涌向各大科学期刊,使得同行评审工作俨然变成一场“灾难”。更严重的是,一些专门刊登AI垃圾稿件的虚假学术期刊也随之出现,借此谋取利益。最终导致的局面是:AI生成的劣质内容,又交由AI模型来开展同行评审,这进一步加重了对学术文献的污染程度。

与此同时,科研人员经常收到通知,被告知自己的研究成果在新论文中被引用,但点进去后却发现,相关引用内容纯属AI虚构。

需要明确的是,目前没有任何证据表明,布赫曾试图将AI生成的劣质内容塞给学生,或是发表不实的AI撰写研究成果。

尽管如此,他的这段惨痛经历,仍为所有人敲响了警钟。

布赫在专栏文章里批评OpenAI,称其在尚未配备能避免用户多年心血付诸东流的“基础防护手段”时,便仓促上线了ChatGPT Plus付费订阅服务。

OpenAI在给《自然》杂志的一份声明里回应道,聊天记录一旦删除就“无法恢复”,并且驳斥了布赫“没有收到任何提示”的说法,着重指出“用户在永久删除聊天记录之前,系统会弹出确认窗口”。这家公司还“贴心地”提议:“用户在进行专业工作时,应当做好个人数据的备份。”

《桃源记2》中石作的建造方式

发布时间:2025-11-26

《英雄联盟手游》5.3d版本更新内容全知晓

发布时间:2025-11-27

《央视影音》把视频保存至手机相册的方法汇总

发布时间:2025-11-27

《原神》中罗莎莉亚圣遗物词条的搭配攻略

发布时间:2025-11-28

《英雄冒险团》战士属性加点攻略分享

发布时间:2025-11-28

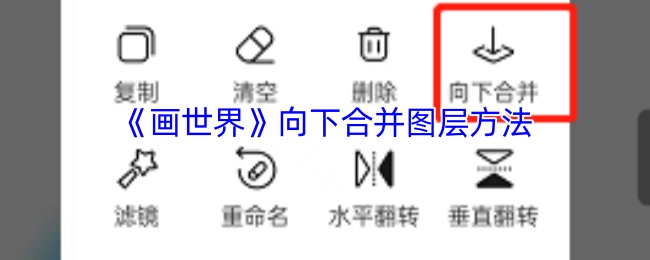

《画世界》中向下合并图层的操作方法

发布时间:2025-11-29

第五人格毛利小五郎皮肤好不好?来看第五人格毛利小五郎皮肤介绍

发布时间:2025-11-29

《羊了个羊12月23日通关攻略,12.23过关技巧大揭秘》

发布时间:2025-11-30